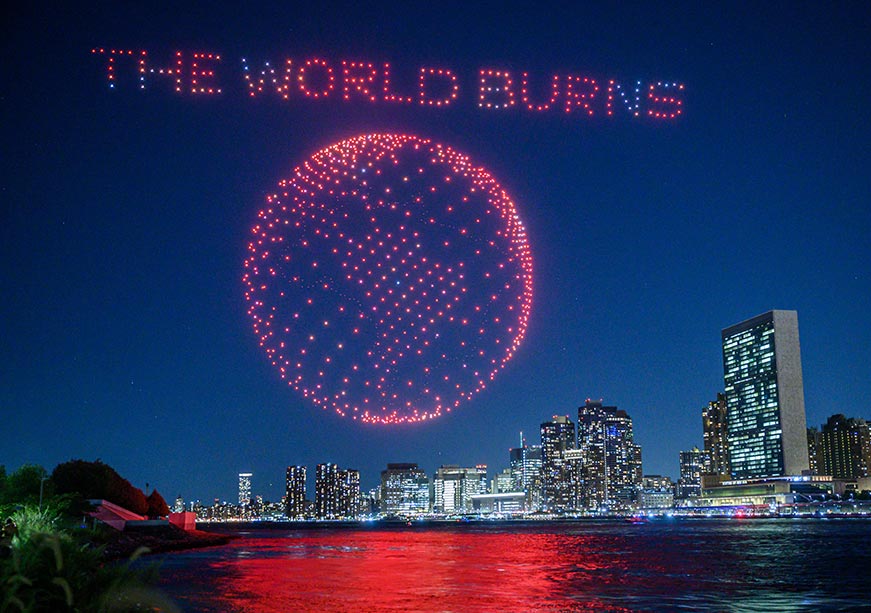

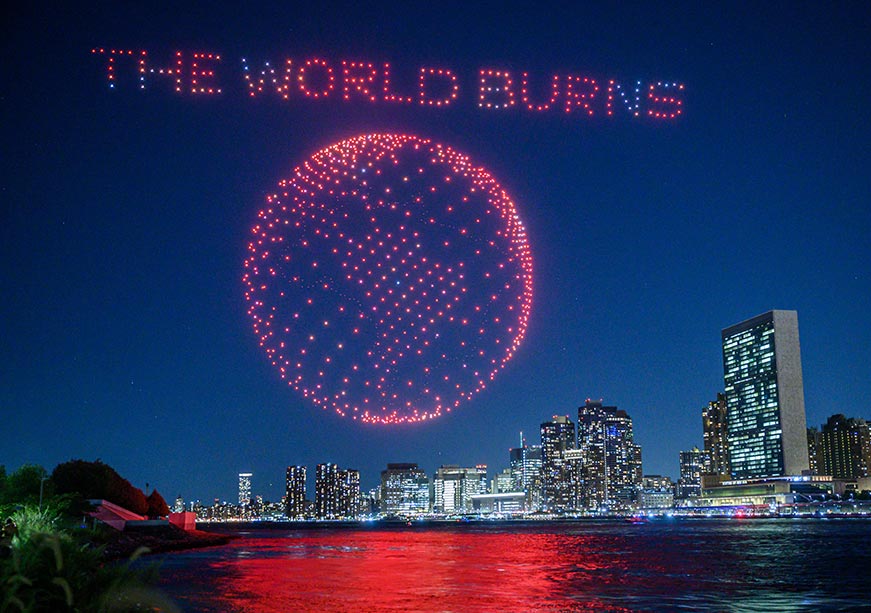

Image Source: Getty

हा लेख ‘रायसीना एडिट २०२५’ या मालिकेचा एक भाग आहे.

2025 च्या पॅरिस AI ॲक्शन समिटमध्ये (PAIAS) युनायटेड स्टेट्स (USA) चे उपाध्यक्ष जे. डी. व्हान्स म्हणाले, "AI चे भविष्य सुरक्षिततेबद्दल हातमिळवणी करून जिंकले जाणार नाही". त्यांच्या या वक्तव्याने तीन महत्त्वपूर्ण वास्तव अधोरेखित होतात. त्यातील पहिले म्हणजे AI हे भविष्यातील परिभाषित तंत्रज्ञान ठरणार आहे. दुसरे AI च्या शर्यतीत काही विजयी ठरतील, तर काही मागे पडतील. आणि तिसरे नियामक धोरणे ठरवतील की एखादे राष्ट्र AI च्या परिवर्तनक्षम शक्तीचा उपयोग करून आपली प्रगती साधू शकते की नाही. तंत्रज्ञान आणि भू-राजकीय वर्तुळात आर्टिफिशियल इंटेलिजन्सचे महत्त्व दिवसेंदिवस चर्चेचा केंद्रबिंदू बनत आहे. उद्योग क्षेत्रातील तज्ज्ञांचा असा विश्वास आहे की मानवता सध्या "बुद्धिमत्ता युगाच्या" उंबरठ्यावर उभी आहे. परिणाम कोणताही असो, अत्याधुनिक AI संशोधन आणि नावीन्य यामध्ये अमेरिका आणि चीनचा मोठा वाटा आहे, आणि याच वास्तवाचा सामना अनेक देशांना करावा लागत आहे. विशेषतः, वॉशिंग्टन आणि बीजिंग यांच्यातील AI च्या शर्यतीत एकमेकांना मागे टाकण्यासाठी सुरू असलेल्या शून्य-सम प्रयत्नांमुळे आंतरराष्ट्रीय सहकार्याला मर्यादा येताना दिसत आहेत.

कोणताही निकाल लागला तरी अत्याधुनिक AI संशोधन आणि नावीन्य यामध्ये अमेरिका आणि चीनमध्ये मोठ्या प्रमाणात केंद्रित आहे, आणि याच वास्तवाला विविध देशांची सरकारे सामोरे जात आहेत.

त्याचबरोबर, AI शर्यत जिंकण्याच्या मोहिमेत जबाबदार नावीन्य आणि आंतरराष्ट्रीय सहकार्याला – विशेषतः आघाडीच्या AI शक्तींमधील वचनबद्धतेला – अधिक महत्त्व दिले जात आहे. संशोधन आणि विकास (R&D) क्षेत्रातील विद्यमान अर्थव्यवस्था, जागतिक नेतृत्वासाठी चाललेल्या भू-राजकीय स्पर्धेची अपरिहार्यता, तसेच देशांतर्गत नियमनविरहित धोरणांकडे झुकण्याचा(inclination) या घटकांमुळे अमेरिकेच्या AI धोरणाने जागतिक AI गव्हर्नन्सच्या तत्त्वांमध्ये वाढती दरी निर्माण केली आहे. ही विभागणी प्रामुख्याने दोन परस्परसंबंधित नियामक मुद्द्यांमधील फरकावर आधारित आहे: AI सुरक्षा आणि AI संरक्षण जागतिक स्तरावर सरकारांच्या विकसित होत असलेल्या नियामक दृष्टिकोनांसाठी या दोन संकल्पना किती महत्त्वाच्या आहेत, याचा सखोल अभ्यास या लेखामध्ये करण्यात येणार आहे.

AI सुरक्षा विरुद्ध AI सुरक्षितता

AI सुरक्षा आणि सुरक्षितता यांच्यातील फरक फक्त शब्दांपुरता मर्यादित असल्यासारखे वाटू शकते, पण प्रत्यक्षात AI नियमनासाठी योग्य धोरणात्मक दृष्टीकोन ठरवण्यासाठी हा एक महत्त्वाचा पैलू आहे. या दोघांमधील मुख्य फरक म्हणजे ते जोखीम, हेतू आणि उत्पत्ती यांच्याकडे नियामक दृष्टिकोनातून कसे पाहतात. AI सुरक्षितता हा केवळ तांत्रिक मुद्दा नसून त्याला एक नैतिक आयाम आहे. AI प्रणालीच्या विकास प्रक्रियेदरम्यान आणि त्याच्या संपूर्ण जीवनचक्रात उद्भवणारे अनपेक्षित परिणाम टाळण्यावर सुरक्षितता भर देते. ही प्रणाली सुरक्षित आणि विश्वासार्ह राहील याची खात्री करण्यासाठी ती विकासकांच्या उद्दिष्टांशी आणि नियामक मानकांशी संरेखित असणे गरजेचे आहे. दुसरीकडे, सुरक्षितता हा दृष्टिकोन AI प्रणालीच्या अंतर्गत जोखमींवर अधिक लक्ष केंद्रित करतो. यात विशेषतः पक्षपाती प्रशिक्षण डेटा, अल्गोरिदममधील पूर्वग्रह, तसेच AI चा अपेक्षित वापर आणि प्रत्यक्ष परिणाम यांच्यातील संभाव्य विसंगती या मुद्द्यांचा समावेश होतो. त्यामुळे, AI च्या भविष्यातील धोरणात्मक वाटचालीत या संकल्पनांची स्पष्ट समज असणे अत्यंत आवश्यक ठरते. याउलट, AI सुरक्षेमध्ये प्रणाली, त्यांचे घटक आणि त्यांच्यावर अवलंबून असलेल्या प्रणालींच्या अखंडतेचे बाह्य धोक्यांपासून संरक्षण करणे समाविष्ट आहे. जर सुरक्षिततेवर अधिक लक्ष केंद्रीत केले गेले, तर AI प्रणालींचा संभाव्य गैरवापर किंवा त्यांचा गैरवापर करण्याचा प्रयत्न करणाऱ्या घटकांना ओळखण्यावर भर दिला जाईल. आदर्श दृष्टिकोन म्हणजे सुरक्षितता आणि सुरक्षेचा समतोल राखणे. मात्र, सुरक्षिततेवर लक्ष केंद्रित करायचे असल्यास, विविध भागधारकांशी दीर्घकालीन सल्लामसलत करून ठोस मार्गदर्शक तत्त्वे आणि धोरणात्मक चौकट तयार करावी लागते. याचे उत्तम उदाहरण म्हणजे 2024 मध्ये मंजूर झालेला युरोपियन युनियन आर्टिफिशियल इंटेलिजन्स अॅक्ट (AIA). दुसरीकडे, सुरक्षा उपाय अधिक वेगाने राबवता येतात, कारण विद्यमान सायबर सुरक्षा फ्रेमवर्क आणि डेटा संरक्षण नियम अंमलात आणून त्याची प्रभावी अंमलबजावणी अल्पावधीत साध्य करता येते. त्यामुळे, AI च्या शाश्वत विकासासाठी सुरक्षितता आणि सुरक्षा या दोन्ही अंगांना योग्य प्रमाणात महत्त्व देणे अनिवार्य ठरते.

AI सुरक्षिततेला एक नैतिक परिमाण आहे. ते प्रणालीच्या संपूर्ण जीवनचक्रादरम्यान उद्भवू शकणाऱ्या अनपेक्षित परिणामांना नियंत्रित करण्यावर लक्ष केंद्रित करते, ज्यामुळे प्रणाली सुरक्षित राहू शकते आणि विकासकांच्या उद्दीष्टांशी तसेच नियामक मानकांशी सुसंगत राहू शकते.

सरकारांनी आपल्या धोरणात्मक दिशेची निश्चिती करताना सुरक्षितता आणि संरक्षण यापैकी कोणाला प्राधान्य द्यायचे, यावर भर द्यायला सुरुवात केली आहे. उदाहरणार्थ, युनायटेड किंग्डम (यूके) आणि अमेरिका या दोन देशांनी PAIAS AI प्रतिज्ञेवर स्वाक्षरी करण्यास टाळाटाळ केली आहे. शिखर परिषदेच्या पार्श्वभूमीवर ब्रिटनच्या विज्ञान, उद्योग आणि तंत्रज्ञान विभागाने (DSIT) आपल्या 'AI सेफ्टी इन्स्टिट्यूट'चे नाव बदलून 'AI सिक्युरिटी इन्स्टिट्यूट' (ASI) असे केले. 2025 म्युनिक सुरक्षा परिषदेत बोलताना ब्रिटनचे तंत्रज्ञान मंत्री पीटर काइल यांनी स्पष्ट केले की, "AI क्रांती" साठी नियामक पुनर्रचना आवश्यक आहे आणि नवीन ASI "पूर्वग्रह किंवा भेदभाव म्हणून काय मोजले जाते, याचा निर्णय घेणार नाही." त्याऐवजी, ही संस्था बाह्य धोके कमी करण्यावर आणि AI प्रणालींची तपासणी करण्यावर लक्ष केंद्रित करेल, मग त्या प्रणाली यूकेच्या मित्रराष्ट्रांशी समन्वय साधून कोणत्या अधिकारक्षेत्रातून आल्या असल्या तरीही.

बायडन प्रशासनाच्या काळात स्थापन झालेल्या US AI सेफ्टी इन्स्टिट्यूटच्या संचालिका एलिझाबेथ केली यांनी राष्ट्राध्यक्ष ट्रम्प यांच्या आर्टिफिशियल इंटेलिजन्सवरील कार्यकारी आदेशाच्या प्रकाशनानंतर आपल्या पदाचा राजीनामा दिला. भू-आर्थिक दृष्टीकोनातून पाहता, "अमेरिकेच्या जागतिक AI वर्चस्वाला" प्रोत्साहन देण्यासाठी डिझाइन करण्यात आलेला हा कार्यकारी आदेश सुरक्षा-समर्थक बदलाचे प्रतीक मानला जात आहे. आंतरराष्ट्रीय स्तरावर, या बदलामुळे अमेरिका आणि चीन यांच्यातील व्यापार शुल्क युद्ध आणि प्रगत यूएस AI चिप्सवरील विद्यमान निर्यात नियंत्रणाच्या संशयास्पद यशाच्या पार्श्वभूमीवर, चिनी पुरवठा साखळी आणखी वेगळी करण्यासाठी कठोर निर्बंध लागू होऊ शकतात. सिंगापूरच्या माध्यमातून एनव्हीडिया चिप्स खरेदी करून अमेरिकेच्या निर्यात नियंत्रणाला डावलण्यात डीपसीक यशस्वी ठरल्याच्या आरोपांमुळे वॉशिंग्टनने सिंगापूरविरोधात आधीच चौकशी सुरू केली आहे. आर्टिफिशियल इंटेलिजन्स सुरक्षेवर लक्ष केंद्रित केल्यास तंत्रज्ञानाच्या प्रसारासाठी नॉन-टॅरिफ व्यापार अडथळे निर्माण होऊ शकतात. याचे प्रत्यंतर म्हणून, चीनच्या डीपसीक R1AI मॉडेलवर घालण्यात आलेली पाश्चिमात्य बंदी पाहायला मिळते. हे मॉडेल स्थानिक पातळीवर कार्यरत राहू शकते, त्यामुळे डेटा सीमापार हस्तांतरित होण्याची गरज भासणार नाही. तसेच, हे कमी संसाधनांवर चालते आणि पाश्चिमात्य पर्यायांच्या तुलनेत किंमत लक्षणीयरीत्या कमी आहे, त्यामुळे त्यावर निर्बंध आणण्याची मागणी पाश्चिमात्य देशांतून होत आहे.

AI साठी नैतिक मार्गदर्शक तत्त्वांचा मसुदा तयार करण्याच्या प्रक्रियेत सहभागी नीतिशास्त्रज्ञांनी या नियमांचे वर्णन सार्वजनिक चिंता दूर करण्यासाठी आणि युरोपियन बाजारपेठेत AI चा स्वीकार वाढवण्यासाठी केलेल्या एक प्रकारचा "नैतिकतेचा दिखावा" म्हणून केले आहे.

सुरक्षा जोखीम-आधारित EU AIA ची पहिली अनुपालन अंतिम मुदत फेब्रुवारी 2025 मध्ये लागू होत असल्याने, ईयूमध्येही सुरक्षा आणि सुरक्षितता यांच्यातील गतिशीलता वेग घेत आहे. AI साठी नैतिक मार्गदर्शक तत्त्वांचा मसुदा तयार करणाऱ्या नीतिशास्त्रज्ञांनी या नियमांचे वर्णन सार्वजनिक चिंता दूर करण्यासाठी आणि युरोपियन बाजारपेठेत AI स्वीकारण्यास चालना देण्यासाठी AI ला "नैतिकतेच्या दिखाव्या"चा एक अप्रत्यक्ष प्रयत्न असल्याचे म्हंटले आहे. AI विकासात सार्वजनिक-खाजगी गुंतवणूक वाढवण्यासाठी आणि विकासकांवरील नियामक बोजा कमी करण्यासाठी युरोपियन नेत्यांनी PAIAS दरम्यान दिलेल्या घोषणांनी काही प्रमाणात या टीकेला पुष्टी मिळवून दिली आहे. 2016 मध्ये लागू झालेल्या जनरल डेटा प्रोटेक्शन रेग्युलेशन (जीडीपीआर) प्रमाणेच, पूर्वीचे नियमन इतर न्यायक्षेत्रांसाठी धोरणात्मक टेम्पलेट बनले, ज्यामुळे युरोपियन युनियनला तंत्रज्ञान नियमनात आघाडीचे स्थान मिळविण्याची संधी मिळाली. त्याच धर्तीवर, EU AIA सारख्या आघाडीच्या नियमनामध्ये जागतिक स्तरावर AI प्रशासनासाठी मानके प्रस्थापित करण्याची क्षमता आहे. AIA च्या पुढील पुनरावृत्तीमध्ये नियमनाच्या मूळ चौकटीला कायम ठेवत अंतर्गत जोखमींपेक्षा बाह्य धोक्यांना प्राधान्य देण्याची भूमिका स्वीकारल्यास त्याचे जागतिक पातळीवर दूरगामी परिणाम होऊ शकतात.

प्रणालीगत जोखीम आणि जागतिक विखंडन

आर्टिफिशियल इंटेलिजन्सच्या शर्यतीत आघाडीवर असलेले देश AI सुरक्षितता आणि सुरक्षा यावर शर्यत लावत असताना, या परिणामस्वरूप जागतिक AI प्रशासनाचे विखंडन दोन प्रमुख क्षेत्रांवर प्रभाव टाकेल—श्रम बाजार आणि पर्यावरणीय टिकाऊपणा. इंटरनॅशनल लेबर ऑर्गनायझेशनचे महासंचालक गिल्बर्ट हुंगबो यांच्या मते, काही नेते, जसे की जे. डी. व्हेन्स, रोजगार विस्थापनाकडे दुर्लक्ष करून, AI च्या उत्पादकता वाढीतील आणि रोजगार निर्मितीतील योगदानाबद्दल आशावादी भूमिका मांडतात. PAIAS साठी तयार करण्यात आलेल्या 2025 च्या आंतरराष्ट्रीय AI सुरक्षा (IAS) अहवालानुसार, सध्याच्या सामान्य-उद्देश AI प्रणाली प्रगत अर्थव्यवस्थांमधील 60 टक्के आणि उदयोन्मुख बाजारपेठांमधील 40 टक्के नोकऱ्यांवर परिणाम करेल.

AI शर्यतीत आघाडीवर असलेल्या देशांमध्ये नियामक कार्यक्षमतेच्या बाजूने शाश्वततेच्या तत्त्वांना मिळणारा पाठिंबा उदयोन्मुख देशांसाठी एक आदर्श मॉडेल बनण्याची क्षमता आहे.

AI विकास ही पर्यावरणीय शाश्वततेच्या उद्दिष्टांसाठी वेगाने वाढणारी समस्या आहे आणि हरितगृह वायू (जीएचजी) उत्सर्जनात योगदान देणारी आहे. जोपर्यंत स्केलिंग कायदे आहेत, तोपर्यंत AI विकासासाठी मोठ्या डेटा सेंटर्स आणि अधिक विस्तृत पायाभूत सुविधांमध्ये गुंतवणूक करावी लागेल, ज्यामुळे संसाधनांच्या वाढत्या वापरामुळे पर्यावरणीय प्रभाव वाढेल. उदाहरणार्थ, मायक्रोसॉफ्टने 2020 मध्ये दशकाच्या अखेरीस कार्बन-निगेटिव्ह होण्याचे वचन दिले होते. तरीही, AI विकासातील गुंतवणुकीमुळे त्याचे कार्बन उत्सर्जन 2023 पर्यंत 30 टक्क्यांनी वाढले. AI शर्यतीत आघाडीवर असलेल्या देशांमध्ये नियामक कार्यक्षमतेच्या बाजूने शाश्वततेच्या तत्त्वांना मिळणारा पाठिंबा उदयोन्मुख देशांसाठीही एक मॉडेल बनण्याची क्षमता आहे. जागतिक AI गव्हर्नन्स लँडस्केपचे पुर्नमॅपिंग काही प्रणालीगत जोखीम सादर करते आणि महत्त्वपूर्ण प्रश्न अनुत्तरित ठेवते. पाश्चिमात्य देशांतील सरकारे सहकारी संबंधांपासून स्पर्धात्मकतेकडे वळत असताना, जबाबदार AI विकासाला चालना देण्यासाठी स्वाक्षरी केलेल्या घोषणा आणि प्रतिज्ञांचे काय होईल? AI गुंतवणूक वाढविण्यासाठी भूराजकीय आणि आर्थिक दबावापुढे सामंजस्य करार आणि PAIAS प्रतिज्ञासारखे बंधनकारक नसलेले करार यासारखे "पिंकी-प्रॉमिसेस" कितपत प्रभावी ठरतील? अशा खुल्या प्रश्नांमुळे संयुक्त राष्ट्रांचे सरचिटणीस अँटोनियो गुटेरेस यांच्या 'आपण भविष्यासाठी तयार आहोत का?' या विधानाला वजन येते. याचे उत्तर सोपे आहे. नाही.

सिद्धार्थ यादव हे ORF मिडल इस्ट येथे टेक्नॉलॉजी फेलो आहेत.

The views expressed above belong to the author(s). ORF research and analyses now available on Telegram! Click here to access our curated content — blogs, longforms and interviews.

PREV

PREV